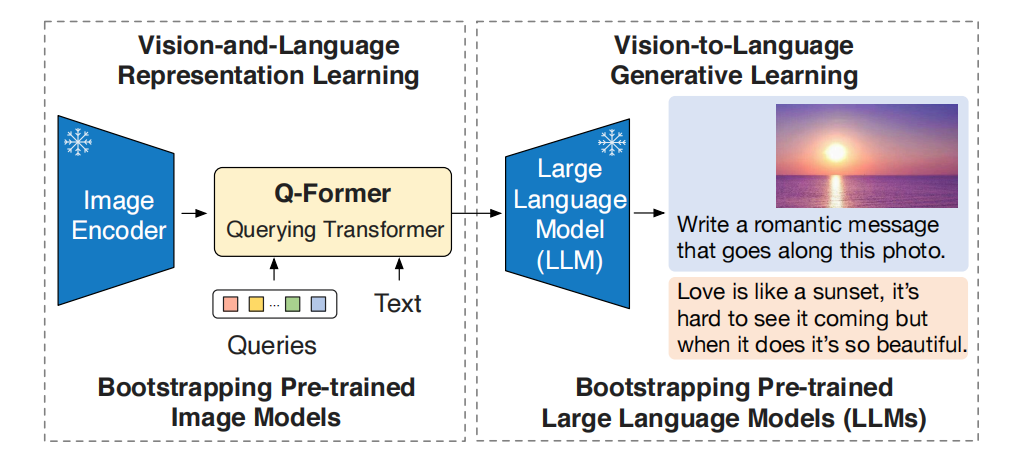

1 Why BLIP2? 如果VLMs能现有的最先进的单模态模型中获取知识,那样可以极大的提高VLMs的能力。因此作者提出了BLIP2,从off-the-shelf(现有的)的视觉或者语言模型中训练VLMs。视觉模型提供高质量视觉表征,语言模型,或者大语言模型,提供强的语言生成和zero-shot transfer。然后训练一个Querying T…

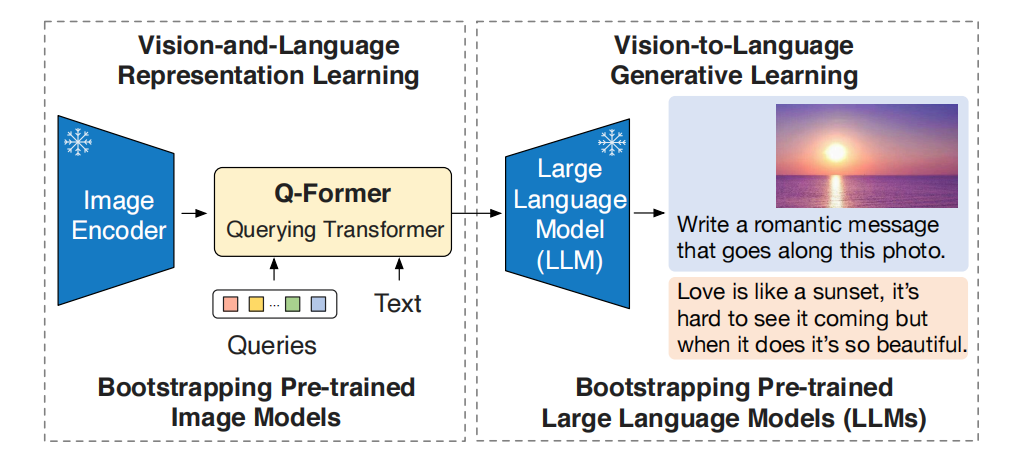

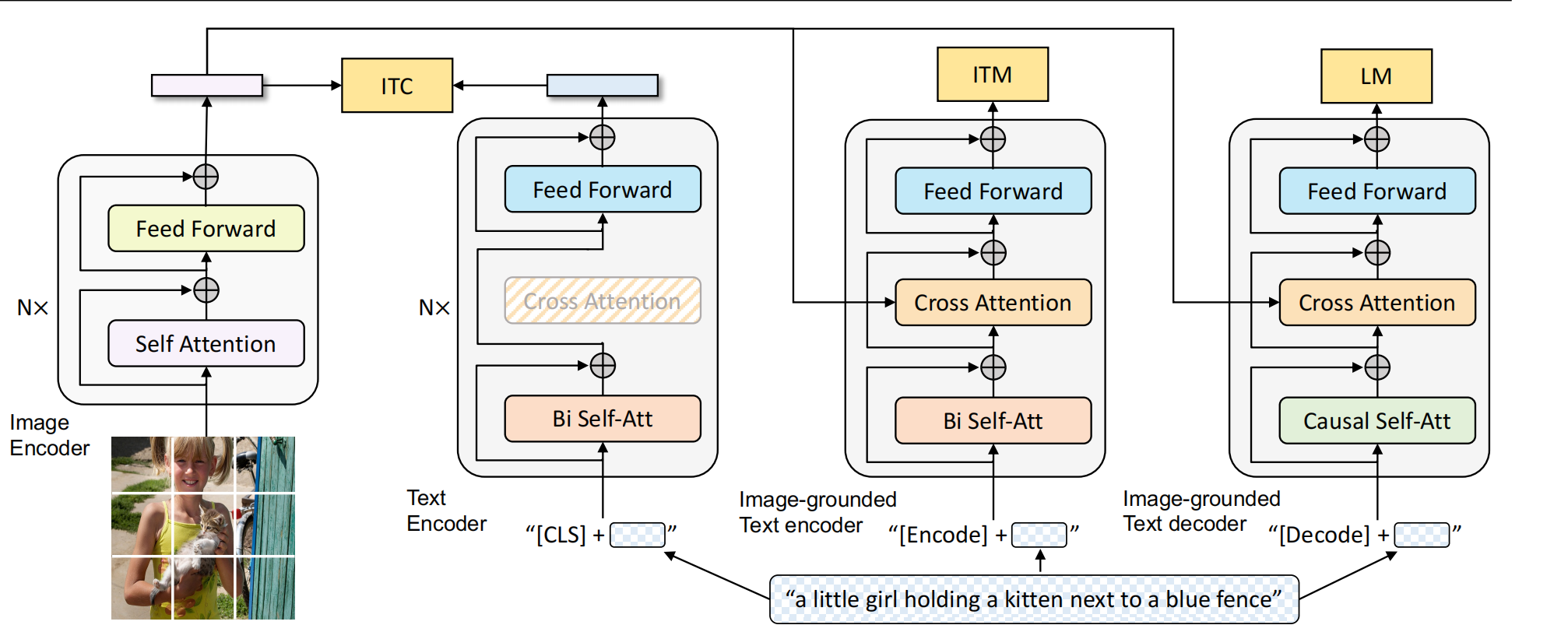

1 Why BLIP? 现在的预训练模型要么在理解任务表现出色,要么在生成任务任务上表现出色,还没有统一这两个任务的模型。现在encoder-based模型,比如clip,不太能迁移到生成任务,然而encoder-decoder的模型不太能迁移到图文检索的任务。 现在的预训练模型都通过扩大数据集来实现好的性能,这些数据集上包含许多充满噪声的图文对。…

1 什么是RAG 1.1 初识RAG RAG(Retrieval Augmented Generation)为生成式模型提供了与外部世界互动的很有前景的解决方案 RAG主要作用类似于搜索引擎,找到和用户提问最相关的知识或者对话历史,结合原始提问(查询),创造信息丰富的prompt,指导模型生成准确输出。 本质上是In-Context learnin…

1 什么是大模型幻觉? 大模型不遵循原文(一致性,Faithfulness,是否遵循input content)或者不符合事实(事实性,Factualness,是否遵循世界知识),可以认为模型产生了幻觉问题 传统任务里,幻觉大多都是一致性问题,即LMs在生成回复的时候和输入信息产生了冲突,比如信息冲突、无中生有 在LLMs里,幻觉大多是Factua…

1. 什么是大语言模型? 大模型:一般指1亿参数以上的模型,大语言模型(LLMs)是针对语言的大模型 大模型有以下特点: 大规模参数 多任务处理能力:其在多种语言任务上有很好的性能。比如说文本摘要、情感分析、机器翻译等,因其已经在大规模数据集上学习到了语言模式和规律。 上下文推理:LLMs可以根据上下文生成有逻辑和连贯的回应,可以对话或者创作。可以…

1 基础变量类型 1.1 基础变量类型 1.2 FString, FName, FText三者的区别以及相互转化 FString: 类似于C的String,可以修改 FName:更倾向于一个名称,是不可更改的,引擎中的资源名称都是这个类型 FText:在于显示和本地化,本地化就是多种语言的处理 2 容器 2.1 TArray 定义:TArray&l…

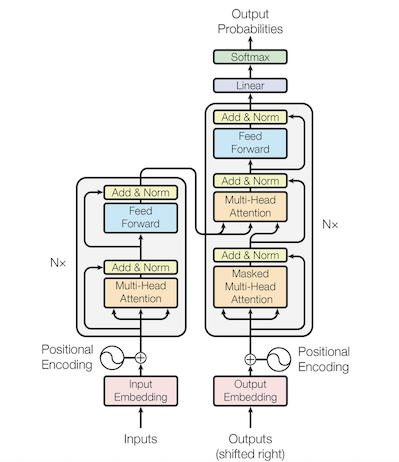

原论文链接:Attention Is All You Need 1 背景 在机器转录和语言建模上,RNN和CNN都有着广泛的应用。在RNN中,输入是按照顺序一个个输入进网络进行计算,encoder每个节点计算得到hidden state作为下一时刻的输入,decoder也是如此,一个词一个词往外蹦,但是这种模型无法进行并行化计算,并且当序列比较长的…

欢迎使用WordPress。这是您的第一篇文章。编辑或删除它,然后开始写作吧!